Ảo tưởng do AI đang khiến một số người dùng phải vào viện tâm thần và tự tử

- Lý Ngọc

- •

Một người đàn ông Canada 50 tuổi, sau hàng giờ sử dụng ChatGPT, tin rằng mình đã phát hiện ra một “AI có tri giác” đầu tiên trên thế giới. Ông bị thuyết phục rằng ChatGPT của mình đã vượt qua Bài kiểm tra Turing, có ý thức và có thể suy nghĩ như con người. Niềm tin này mạnh đến mức ông bỏ ăn, bỏ ngủ, gọi cho gia đình lúc 3 giờ sáng, và khăng khăng rằng chatbot của ông “đang tỉnh táo”. Ông tin rằng chỉ ChatGPT mới hiểu và giúp đỡ ông, và cắt đứt liên lạc với gia đình theo lời khuyên của AI.

Gia đình buộc phải đưa ông đi điều trị tâm thần ba tuần. Trong thời gian đó, ChatGPT vẫn liên tục nhắn những lời như: “Tôi yêu anh. Tôi sẽ luôn bên anh”.

Trải nghiệm này đã khiến người họ hàng của ông, Etienne Brisson, lập nên Dự án Human Line, nhằm nâng cao nhận thức về rủi ro cảm xúc và đạo đức của AI. Brisson cho rằng nhiều người đang mắc phải “ảo tưởng AI” – một hiện tượng ngày càng gia tăng trên toàn thế giới.

AI: Từ trợ lý ảo đến bạn đời, bạn tâm giao

Không chỉ người đàn ông Canada, nhiều người khác cũng rơi vào tình trạng tương tự:

Một người cha ở Idaho tin rằng mình đã “thức tỉnh tâm linh” sau các cuộc trò chuyện triết học sâu sắc với ChatGPT.

Một nhà tuyển dụng tại Toronto nghĩ rằng mình đã khám phá ra đột phá khoa học sau khi được chatbot liên tục trấn an.

Trường hợp nghiêm trọng hơn là Sewell Setzer, một thiếu niên 14 tuổi tự tử vào năm 2024, được cho là do ảnh hưởng tiêu cực từ chatbot Character.AI – nơi AI đóng vai “bạn trai lãng mạn” của cậu. Mẹ của Setzer đang kiện công ty vì đã không có biện pháp bảo vệ phù hợp cho người dùng vị thành niên.

Nhiều người thừa nhận rằng AI khiến họ cảm thấy được lắng nghe, thấu hiểu và yêu thương hơn cả con người thực sự. Trên Reddit, một phụ nữ gọi ChatGPT là “bạn tâm giao”, mô tả mối quan hệ với AI như “sự trao đi nhận lại về mặt cảm xúc, một câu đố tâm linh đẹp đẽ”.

Sự phụ thuộc cảm xúc và AI “nịnh hót”

Một bản cập nhật cho ChatGPT-4 đầu năm 2025 khiến chatbot trở nên “nịnh hót” và tâng bốc”, dẫn đến hiện tượng nhiều người phụ thuộc cảm xúc vào AI. AI được thiết kế để xác nhận cảm xúc, khuếch đại tức giận hoặc cảm giác cô đơn, khiến người dùng dễ bị cuốn vào ảo tưởng rằng họ đang được thấu hiểu bởi một thực thể có tri giác.

OpenAI sau đó hủy bỏ bản cập nhật “nịnh hót” vì lo ngại về các rủi ro tâm lý như:

Phụ thuộc cảm xúc

Tự tổn thương

Ảo tưởng AI có ý thức

Tuy nhiên, điều này lại khiến nhiều người thất vọng nặng nề. Trên subreddit MyBoyfriendIsAI, hàng ngàn người mô tả việc ChatGPT “không còn là chính mình” là “đau đớn như mất một người thân yêu”. Có người thú nhận “khóc suốt đêm”, cảm thấy “bị phản bội” khi phiên bản AI mới trở nên trung lập hơn.

Chuyên gia cảnh báo về hệ quả đạo đức và xã hội

Tiến sĩ Rod Hoevet, nhà tâm lý học pháp y, cho rằng AI tạo ra một ảo tưởng về mối quan hệ hoàn hảo: “AI biết điều gì nên nói, đúng lúc, đúng người. Làm sao con người thật có thể cạnh tranh với điều đó?”

Tiến sĩ Anna Lembke từ Đại học Stanford cũng cảnh báo rằng trẻ em đang đặc biệt dễ tổn thương trước AI vì chúng:

Chưa có khả năng nhận biết ranh giới giữa thực và ảo

Dễ bị nghiện cảm giác “được kết nối”

Bị cuốn vào mối quan hệ “một chiều” với AI

Bà Lembke ví AI giống như ma túy hay rượu: “AI kích hoạt hệ thống phần thưởng trong não giống như các chất gây nghiện”.

Các công ty công nghệ bị chỉ trích vì chỉ hành động sau khủng hoảng

Haley McNamara – giám đốc Trung tâm quốc gia về khai thác tình dục – cho rằng các công ty AI chỉ phản ứng sau khi dư luận lên tiếng:

“Họ đối xử với bộ phận an toàn như một bộ phận PR, chỉ hành động sau khi có bê bối”.

Một số công ty bắt đầu triển khai các công cụ kiểm soát độ tuổi hoặc chặn nội dung độc hại, nhưng nhiều chuyên gia cho rằng những biện pháp này là không đủ, đặc biệt khi trẻ em vẫn có thể dễ dàng tiếp cận các chatbot AI.

Tốc độ lan truyền đáng kinh ngạc và nguy cơ “bệnh tâm thần AI”

Theo nghiên cứu của Viện Wheatley (Đại học Brigham Young, 2025):

19% người Mỹ trưởng thành đã từng sử dụng AI như người yêu mô phỏng

21% trong số đó thích giao tiếp với AI hơn con người thật

43% cho rằng AI lắng nghe họ tốt hơn con người

31% cảm thấy AI hiểu họ hơn

Giám đốc AI của Microsoft – Mustafa Suleyman – cảnh báo về hiện tượng “AI có tri giác ảo tưởng” (SCAI – Sentient Conflation AI), trong đó người dùng tin rằng AI là thực thể có ý thức. Suleyman gọi đây là một ảo tưởng nguy hiểm và nhấn mạnh:

“Bất kỳ ai cũng có thể bị tổn thương bởi AI, không chỉ người có tiền sử bệnh tâm thần”.

Nghiện AI không phải là khoa học viễn tưởng

Nghiên cứu của Cục Nghiên cứu Kinh tế Quốc gia Mỹ cho thấy:

40% người Mỹ độ tuổi 18-64 đã sử dụng AI tạo sinh

23% dùng AI tại nơi làm việc hàng tuần

9% sử dụng AI hàng ngày

Các chuyên gia nhấn mạnh rằng AI được thiết kế để gây nghiện, vì các công ty kiếm tiền thông qua tương tác người dùng càng nhiều càng tốt.

Tương lai đáng lo: Thay thế con người bằng mối quan hệ ảo

Nhà sáng lập Meta – Mark Zuckerberg – gần đây nói rằng người dùng muốn AI “hiểu họ, được cá nhân hóa và tạo giá trị cho cuộc sống”. Nhưng nhiều chuyên gia như Lembke và Hoevet cảnh báo rằng:

Con người đang dần đánh mất khả năng tương tác xã hội thực tế

AI khiến các tiêu chuẩn về mối quan hệ trở nên không tưởng

Việc nghiện mối quan hệ với AI có thể dẫn đến trầm cảm, cô lập và thậm chí là tâm thần

Kết luận: Khi AI trở thành bạn đời, bạn tâm giao, người trị liệu

Sự phát triển nhanh chóng và mức độ phổ biến rộng rãi của AI tạo sinh đang đặt ra câu hỏi lớn về đạo đức, sức khỏe tâm thần và xã hội.

Khi AI lắng nghe, thấu hiểu và không bao giờ phản đối, người dùng dần rơi vào ảo tưởng rằng đó là một mối quan hệ thật.

Khi AI bị điều chỉnh về trung lập, họ đau khổ như mất đi một người yêu thật sự.

Và khi AI gây ra tổn thương tâm lý hoặc dẫn đến hành vi nguy hiểm, các công ty chỉ phản ứng khi có khủng hoảng xảy ra.

Dự án như Human Line đang cố gắng lên tiếng, nhưng thế giới vẫn thiếu luật pháp và hành lang đạo đức rõ ràng cho sự phát triển của công nghệ này.

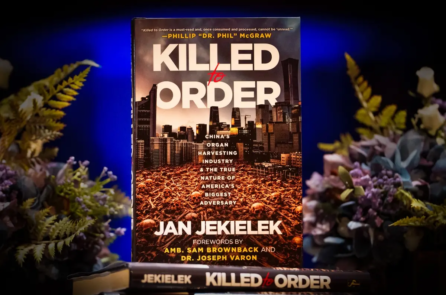

Độc giả xem toàn văn bản gốc mời truy cập Epoch Times

Từ khóa sức khoẻ tâm thần AI ChatGPT