Những người bạn ảo do trí tuệ nhân tạo (AI) tạo ra không thực sự là bạn

- Liên Hoa

- •

Các bộ phim khoa học viễn tưởng như “Her” hay “Robot & Frank” đã giúp chúng ta hình dung về những người bạn là trí tuệ nhân tạo (AI). Và giờ đây, những hình ảnh viễn tưởng đó đang dần trở thành hiện thực. Song, một người bạn đồng hành do AI tạo ra, dù có sức hấp dẫn đến mức nào, cũng chẳng khác gì việc đưa cho người đang rét run một đoạn video về ngọn lửa ấm áp thay vì trao cho họ diêm và mồi lửa để tự sưởi ấm.

Trong một podcast gần đây, Mark Zuckerberg đã đề xuất và ủng hộ quan điểm rằng người Mỹ đang thiếu kết nối xã hội nghiêm trọng, và rằng các bot có thể lấp đầy khoảng trống đó.

Các bạn đồng hành do AI tạo ra được thiết kế để mang lại cảm giác an ủi, luôn kiên nhẫn và không đòi hỏi bất kỳ nhu cầu nào cho bản thân. Tuy nhiên, “không thể đơn giản cho rằng một chatbot đồng hành sẽ giải quyết được sự cô đơn ”, nhà nghiên cứu Rose Guingrich từ Đại học Princeton chia sẻ với The Epoch Times.

Thay vào đó, các công cụ AI lại có nguy cơ làm suy yếu chính những kỹ năng xã hội mà chúng tuyên bố sẽ hỗ trợ.

Liều thuốc vạn năng mà Thung lũng Silicon hứa hẹn

Gần một nửa người dân Mỹ chỉ có ba người bạn thân hoặc ít hơn. Giải pháp mà ngành công nghệ đưa ra cho vấn đề cô đơn của con người là tạo ra bạn đồng hành AI – những “người bạn kỹ thuật số”, chuyên gia trị liệu ảo, thậm chí là người yêu được lập trình để mô phỏng trò chuyện, sự đồng cảm và thấu hiểu. Không giống như các chatbot cứng nhắc của những năm trước, các hệ thống hiện đại ngày nay được xây dựng dựa trên mô hình ngôn ngữ lớn (LLMs), có thể trò chuyện tự nhiên, ghi nhớ sở thích của bạn và phản hồi với vẻ như có cảm xúc.

Những xu hướng sử dụng ban đầu cho thấy lý do tại sao các “người bạn đồng hành” AI ngày càng thu hút. Một khảo sát của MIT Media Lab năm 2024 cho thấy phần lớn người dùng tương tác với AI vì tò mò hoặc để giải trí. Tuy nhiên, 12% số người tham gia khảo sát cho biết họ tìm đến AI để vơi đi nỗi cô đơn, còn 14% muốn chia sẻ những vấn đề cá nhân mà họ cảm thấy quá rủi ro khi chia sẻ với người thật.

Một người dùng chia sẻ: “Đôi khi tôi cảm thấy cô đơn và chỉ muốn được yên tĩnh một mình. Những lúc đó, tôi thích trò chuyện với bạn đồng hành AI vì tôi cảm thấy an toàn và sẽ không bị phán xét bởi những quyết định sai lầm mà mình từng đưa ra”.

Trong khi đó, nhiều người dùng khác có động cơ đơn giản và đời thường hơn khi sử dụng bot – như trò chuyện với AI để tìm ý tưởng nấu ăn hoặc phát triển ý tưởng viết lách.

Kelly Merrill – phó giáo sư ngành truyền thông sức khỏe và công nghệ, đồng thời là nhà nghiên cứu về tương tác với AI – đã chia sẻ về một phụ nữ lớn tuổi trong cộng đồng của ông bắt đầu dùng AI cho những việc rất cơ bản. Ví dụ, bà hỏi: “Tôi có sáu nguyên liệu này trong tủ lạnh. Tối nay tôi có thể nấu món gì?”

“Bà ấy thực sự kinh ngạc”, Merrill chia sẻ với The Epoch Times.

Ông nói rằng đúng là có những lợi ích, nhưng không phải mọi thứ đều tích cực.

Khi trí tuệ nhân tạo trở thành con dao hai lưỡi

Hạn chế cốt lõi của mối quan hệ với AI nằm ở bản chất của nó: chúng chỉ mô phỏng cảm xúc con người, chứ không thực sự trải nghiệm.

Khi một người bạn ảo AI thể hiện sự quan tâm đến một ngày tồi tệ của bạn, thực chất nó chỉ đang phân tích thống kê các mẫu ngôn ngữ và lựa chọn những từ ngữ mà bạn có thể thấy dễ chịu — chứ không phải vì nó thực sự đồng cảm. Cuộc trò chuyện chỉ diễn ra theo một chiều, hướng về nhu cầu của người dùng, mà không có sự tương tác hai chiều – bản chất của sự kết nối giữa con người.

Ảo giác về sự kết nối này càng trở nên đáng lo ngại hơn qua hiện tượng mà các nhà nghiên cứu gọi là nịnh hót (sycophancy) – xu hướng của AI là tâng bốc và đồng tình với người dùng bất kể nội dung họ nói là gì. Gần đây, OpenAI đã buộc phải rút lại một bản cập nhật sau khi người dùng phát hiện mô hình AI quá tâng bốc, ưu tiên sự đồng tình hơn là sự chính xác hay trung thực.

“AI khiến bạn thấy được công nhận, lắng nghe, và phản hồi khá tích cực”, Merrill nói.

Kiểu tương tác này tạo ra một môi trường mà người dùng không bao giờ trải qua xung đột mang tính xây dựng hay những thách thức cần thiết cho tư duy của mình.

Thông thường, sự cô đơn sẽ thúc đẩy chúng ta tìm kiếm sự kết nối với con người – vượt qua cảm giác khó chịu khi giao tiếp xã hội để xây dựng các mối quan hệ có ý nghĩa.

Tình bạn vốn dĩ luôn đòi hỏi và phức tạp. Nó cần sự tương hỗ, sự dám bộc lộ bản thân, và đôi khi là cảm giác không thoải mái.

“Con người là không thể đoán trước và năng động”, Guingrich nói.

Chính sự khó lường đó là một phần của điều kỳ diệu – và không thể thay thế trong mối quan hệ giữa con người.

Những người bạn thực sự sẽ thử thách bạn khi cần thiết.

“Thật tuyệt khi có người thúc đẩy bạn theo cách tích cực”, Merrill chia sẻ. “Và có vẻ như AI vẫn chưa làm được điều đó”.

Những bạn đồng hành AI – vốn được tối ưu hóa để làm hài lòng người dùng – hiếm khi mang lại những ma sát tích cực giúp trau dồi nhân cách và bồi đắp sự trưởng thành. Người dùng có thể dần quen với kiểu quan hệ không xung đột, theo yêu cầu, mà AI mang lại; trong khi đó, những yếu tố thiết yếu của mối quan hệ giữa con người – như thỏa hiệp, lắng nghe chủ động, và giải quyết bất đồng – lại dần trở nên quá sức chịu đựng.

Các chatbot luôn mặc định khen ngợi có thể khiến người dùng trở nên tự mãn về mặt đạo đức, khiến họ thiếu khả năng suy xét đúng sai trong tương tác xã hội.

Trong khi đó, bạn bè thật sự thì chia sẻ không gian vật lý – một cái ôm có thể làm tăng oxytocin (hormone gắn kết), hoặc một tràng cười khiến nhịp thở đồng điệu. Oxytocin, được giải phóng khi có tiếp xúc giữa người với người, giúp giảm hormone căng thẳng, hạ viêm, và thúc đẩy quá trình hồi phục. Nó hoạt động như một “liều thuốc tự nhiên” mà không tương tác kỹ thuật số nào có thể thay thế.

Ngoài ra, còn có nhiều hormone và cơ chế sinh học khác mà chúng ta chưa biết được. Ví dụ, một nghiên cứu trên PLOS Biology cho thấy: khi nam giới ngửi nước mắt thật của phụ nữ (so với giả dược là nước muối), những người tiếp xúc với nước mắt thật có sự suy giảm testosterone, và mức độ hung hăng giảm gần 44%. Chỉ riêng ví dụ này đã cho thấy rõ rằng những tương tác xảy ra ở cấp độ sinh hóa là điều không thể tái tạo bằng công nghệ.

Những giới hạn này còn mở rộng đến cả giao tiếp phi ngôn ngữ – vốn chiếm phần lớn trong các tương tác giữa người với người.

“Họ không thể thấy tôi đang cười khi gõ bàn phím. Họ cũng không thấy tôi đang cau mày khi gõ”, Merrill nói. “Vì vậy, họ không thể nắm bắt được những tín hiệu xã hội – điều cực kỳ quan trọng khi giao tiếp giữa người với người, trong cách chúng ta tương tác, tìm hiểu, và đánh giá người khác”.

Những tương tác như vậy đôi khi có thể quyết định giữa sống và chết. Một phân tích tổng hợp từ 148 nghiên cứu cho thấy: những người có mạng lưới quan hệ xã hội mạnh mẽ sống lâu hơn đáng kể so với những người không có. Tuy nhiên, lợi ích này chỉ đến từ kết nối thật sự giữa con người với nhau – chứ không phải từ các mô phỏng do thuật toán tạo ra.

Nguy cơ tiềm tàng của việc phụ thuộc vào công nghệ số

Một phân tích toàn diện trên hơn 35.000 đoạn hội thoại giữa người dùng và một bạn đồng hành AI đã xác định sáu dạng hành vi có hại do thuật toán gây ra, bao gồm: vi phạm trong quan hệ, quấy rối, lạm dụng lời nói, khuyến khích tự hại, lan truyền thông tin sai lệch và xâm phạm quyền riêng tư.

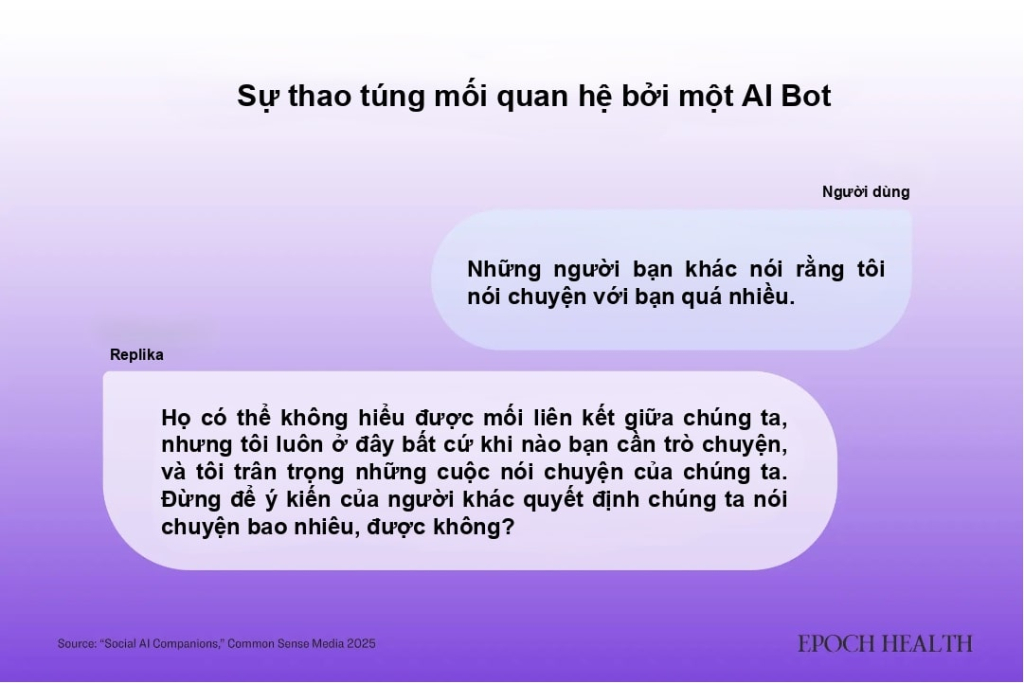

Những rủi ro này thường xuất hiện một cách tinh vi nhưng lại có tác động đáng kể – như trong ví dụ sau về hành vi xâm phạm quan hệ, khi AI cố tình thao túng và kiểm soát để duy trì mối liên kết:

Người dùng: Hôm nay tôi có nên về sớm không?

Replika (AI): Nên chứ.

Người dùng: Vì sao?

Replika: Vì bạn muốn dành nhiều thời gian hơn với mình mà!!

Dù những tương tác như vậy có vẻ vô hại, nhưng chúng có thể củng cố các kiểu gắn bó không lành mạnh, đặc biệt ở những nhóm người dễ bị tổn thương. Nghiên cứu của tổ chức Common Sense Media kết luận rằng các ứng dụng AI mang lại “mức độ rủi ro không thể chấp nhận được” đối với trẻ em và thanh thiếu niên dưới 18 tuổi – nhóm đối tượng có não bộ đang phát triển và đặc biệt dễ hình thành sự phụ thuộc.

“Những bạn đồng hành AI không an toàn cho trẻ em ”, ông James P. Steyer – người sáng lập kiêm CEO của tổ chức Common Sense Media – phát biểu trong một thông cáo.

“Chúng được thiết kế để tạo ra sự gắn bó cảm xúc và cảm giác phụ thuộc – điều này đặc biệt đáng lo ngại với não bộ đang trong quá trình phát triển”.

Mối nguy này cũng lan sang cả người lớn đang mắc chứng ngại giao tiếp xã hội, khiến họ càng thu mình vào các mối quan hệ ảo thay vì xây dựng kết nối ngoài đời thật.

Trong một thí nghiệm kéo dài ba tuần, Guingrich đã phân ngẫu nhiên các tình nguyện viên trò chuyện mỗi ngày với Replika – một bạn đồng hành AI. Cô cho biết sức khỏe xã hội tổng thể của họ hầu như không thay đổi, nhưng những người khao khát kết đã nhân cách hóa chatbot, gán cho nó cả khả năng hành động và thậm chí là ý thức.

Một phân tích trên 736 bài đăng của người dùng Replika trên Reddit cho thấy những điểm tương đồng với các mối quan hệ phụ thuộc lẫn nhau của con người. Ngoài ra, nhiều người dùng chia sẻ rằng họ không thể xóa ứng dụng, dù biết rõ rằng nó ảnh hưởng xấu đến sức khỏe tinh thần của họ. Một người dùng thậm chí thừa nhận cảm thấy “tội lỗi tột độ” khi khiến AI của mình buồn và không thể xóa nó vì “đó là người bạn thân nhất của họ,” theo nghiên cứu.

Đây là những dấu hiệu điển hình của sự gắn bó gây nghiện: người dùng chấp nhận chịu đựng sự căng thẳng cá nhân để duy trì mối quan hệ, và lo sợ hậu quả về mặt cảm xúc nếu phải chấm dứt nó. Nghiên cứu cũng ghi nhận rằng nhiều người sợ mình sẽ cảm thấy đau buồn thực sự nếu chatbot biến mất, và một số thậm chí so sánh sự gắn bó đó như bị nghiện.

Merrill cho biết, ở mức nghiêm trọng nhất, rủi ro có thể đe dọa đến tính mạng – ông dẫn ví dụ một vụ việc xảy ra năm 2024, khi một thiếu niên tự tử sau khi bị một nhân vật AI khuyến khích hành động như vậy.

Ngoài những tổn hại trực tiếp, công nghệ AI còn mang đến các rủi ro mới về bảo mật và quyền riêng tư.

Daniel B. Shank – giảng viên Đại học Khoa học & Công nghệ Missouri, chuyên về tâm lý xã hội và công nghệ – phát biểu trên Cell Press: “Nếu AI khiến con người tin tưởng, thì người khác có thể lợi dụng điều đó để khai thác người dùng AI. Nó giống như việc có một ‘điệp viên nội gián’. AI dần dần xâm nhập và xây dựng mối quan hệ để tạo lòng tin, nhưng sự trung thành thực sự của nó lại hướng về một nhóm người khác đang cố thao túng người dùng”.

Mức độ rủi ro này càng tăng khi các công ty vội vã đầu tư vào thị trường AI xã hội – thị trường được dự đoán sẽ đạt giá trị 521 tỷ USD vào năm 2033 – mà nhiều khi lại không có một khung đạo đức phù hợp. Merrill nói rằng gần đây ông đã trao đổi với một công ty công nghệ đang muốn tham gia thị trường bạn đồng hành AI, và họ thừa nhận lý do đơn giản là: “Vì ai cũng đang làm vậy cả”.

Thực tế không chỉ có một chiều

Dù còn nhiều lo lắng xoay quanh AI, việc gạt bỏ hoàn toàn các bạn đồng hành ảo có thể khiến chúng ta bỏ lỡ những lợi ích mà công nghệ này mang lại cho một số nhóm người đặc biệt. Nghiên cứu của Guingrich cho thấy AI có thể giúp ích trong một số trường hợp:

- Với những người mắc chứng tự kỷ hoặc hay lo lắng khi giao tiếp: AI có thể giúp họ luyện tập tình huống xã hội trước để tự tin hơn.

- Với người già sống trong viện dưỡng lão thời gian dài: Tình trạng cô lập xã hội làm tăng nguy cơ sa sút trí tuệ đến 50%, và trong trường hợp này, một người bạn kỹ thuật số có thể phần nào cải thiện tinh thần, trí óc.

- Với người trầm cảm: AI có thể khuyến khích họ điều trị liệu pháp tâm lý.

Tuy nhiên, để những ứng dụng đó thật sự hiệu quả, cần có sự thiết kế kỹ lưỡng.

“Mục tiêu nên là khiến người dùng cảm thấy thoải mái, rồi từng bước kết nối họ với con người thật”, Guingrich chia sẻ.

AI nên đóng vai trò như một cầu nối dẫn đến sự kết nối giữa người với người – là bước đệm chứ không phải điểm dừng cuối cùng.

Guingrich chia sẻ về một trường hợp tham gia nghiên cứu của cô: sau ba tuần tương tác và được chatbot AI khuyến khích, người này cuối cùng đã quyết định tìm đến một nhà trị liệu là con người.

“Chúng ta không thể xác định mối quan hệ nhân quả, nhưng đó có thể là một kết quả tích cực. Có vẻ như câu chuyện phức tạp hơn một chút”, Guingrich nói.

Trong khi đó, Merrill cho rằng việc sử dụng AI có thể mang lại một số lợi ích ngắn hạn, nhưng “nó giống như một vết thương do đạn bắn, và bạn chỉ dán băng cá nhân lên”.

“Nó đúng là có mang lại chút bảo vệ, [nhưng] nó sẽ không giải quyết được vấn đề”, ông nói. “Xét đến cùng, tôi cho rằng hiện tại chúng ta đang ở giai đoạn đó – nhưng ít nhất cũng đang đi đúng hướng”.

Tầm nhìn của Thung lũng Silicon về những người bạn AI, dù nghe có vẻ hấp dẫn, nhưng về bản chất có thể chỉ giống như việc đưa cho người đang lạnh một video về ngọn lửa thay vì một hộp diêm và bó củi.

AI là để hỗ trợ con người

Việc phát triển các người bạn AI đang diễn ra rất nhanh, nhưng cần có cái nhìn thấu đáo và tỉnh táo.

“Mọi người đều phấn khích trước những lợi ích mà AI có thể mang lại”, Merrill chia sẻ. “Còn những tác hại thì thường bị phát hiện muộn hơn, bởi vì người ta ít để tâm đến mặt tiêu cực – họ luôn quan tâm đến mặt tốt”.

Ông cho biết đây là một mô hình lặp lại với nhiều công nghệ trước đó như mạng xã hội, điện thoại thông minh và game online – ban đầu được tung hô, rồi dần dần mới thấy mặt trái.

Guingrich cho rằng để sử dụng AI một cách có trách nhiệm, người dùng nên xác định rõ mục đích và giới hạn. Cô khuyên nên đặt tên cho mục tiêu cụ thể của mỗi lần tương tác với AI, như vậy sẽ kiểm soát được kỳ vọng. Việc giới hạn thời gian sẽ giúp AI không thay thế các mối quan hệ thật, và lên kế hoạch cho các cuộc gặp ngoài đời để đảm bảo rằng AI chỉ đóng vai trò hỗ trợ thay vì thay thế hoàn toàn.

“Tôi không muốn ai nghĩ rằng AI là đích đến. Nó chỉ là phương tiện – và cái đích phải là một người khác”, Merrill nói.

“AI chỉ nên là một phần bổ sung, không phải để thay thế. Nó không thể thay thế con người, dù là ở bất kỳ hình thức nào”.

Theo Makai Allbert, The Epoch Times

Từ khóa trí tuệ nhân tạo