DeepSeek và loạt công ty Trung Quốc bị tố khai thác trái phép công nghệ AI của Mỹ

- Lâm Yến

- •

Từ khóa Dòng sự kiện DeepSeek Anthropic

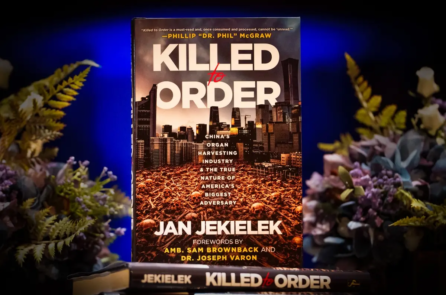

Thứ Hai (23/2), công ty trí tuệ nhân tạo Mỹ Anthropic cho biết 3 công ty Trung Quốc đã lợi dụng chatbot Claude của họ để thu thập năng lực trái phép nhằm cải thiện mô hình riêng. Anthropic đồng thời kêu gọi áp đặt các biện pháp kiểm soát xuất khẩu đối với chip AI cao cấp.

Trước đó, OpenAI – công ty phát triển ChatGPT – đã công bố một bản ghi nhớ cảnh báo rằng công ty AI Trung Quốc DeepSeek đang nhắm vào ChatGPT và Claude, tìm cách sao chép các mô hình AI của Mỹ để phục vụ cho việc huấn luyện nội bộ.

Trong bài viết trên blog hôm thứ Tư, Anthropic nêu đích danh ba công ty AI Trung Quốc gồm DeepSeek, Moonshot AI và MiniMax. Công ty cho biết các doanh nghiệp này đã sử dụng khoảng 24.000 tài khoản giả để thực hiện “các cuộc tấn công chưng cất ở quy mô công nghiệp” nhằm vào Claude, với tổng số lần tương tác lên tới 16 triệu lần, vi phạm điều khoản dịch vụ và các hạn chế truy cập theo khu vực.

Anthropic cho biết các công ty Trung Quốc đã sử dụng kỹ thuật “chưng cất”, tức là dùng đầu ra của mô hình mạnh để huấn luyện mô hình yếu hơn. Nói cách khác, các công ty AI Trung Quốc bị cáo buộc khai thác trái phép năng lực mô hình của đối thủ Mỹ nhằm tiết kiệm thời gian và chi phí nghiên cứu phát triển.

“Cường độ và mức độ phức tạp của các hoạt động tấn công này đang không ngừng gia tăng. Cửa sổ hành động rất hẹp, và phạm vi đe dọa vượt xa bất kỳ công ty hay khu vực nào”, tuyên bố cho biết.

Anthropic cảnh báo rằng các mô hình được chưng cất bất hợp pháp này thiếu các cơ chế bảo vệ an toàn cần thiết, từ đó có thể tạo ra rủi ro nghiêm trọng đối với an ninh quốc gia.

Bài blog nêu rõ: “Các hệ thống do Anthropic và các công ty Mỹ khác xây dựng nhằm ngăn chặn các chủ thể nhà nước và phi nhà nước sử dụng AI để phát triển vũ khí sinh học hoặc tiến hành các hoạt động mạng độc hại”.

“Những mô hình được xây dựng thông qua chưng cất bất hợp pháp khó có thể giữ lại các biện pháp bảo vệ này, đồng nghĩa với việc các năng lực nguy hiểm có thể nhanh chóng lan rộng trong bối cảnh nhiều lớp bảo vệ hoàn toàn mất hiệu lực”, bài viết bổ sung.

Anthropic cho rằng nếu các phòng thí nghiệm nước ngoài có thể trích xuất mô hình công nghệ của Mỹ, họ có thể tích hợp các năng lực không được bảo vệ này vào hệ thống quân sự, tình báo và giám sát, tạo điều kiện để các chính phủ chuyên chế sử dụng AI tiên tiến cho tấn công mạng, tuyên truyền sai lệch và giám sát quy mô lớn.

“Nếu các mô hình này được mã nguồn mở, rủi ro sẽ gia tăng theo cấp số nhân, vì các năng lực liên quan sẽ tự do lan rộng mà không chịu sự kiểm soát của bất kỳ chính phủ chuyên chế nào”, bài viết nhấn mạnh.

Anthropic cho biết vì lý do an ninh quốc gia, công ty hiện không cung cấp quyền truy cập thương mại tại Trung Quốc đại lục hoặc cho các công ty liên kết ở nước ngoài của Trung Quốc. Tuy nhiên, một số phòng thí nghiệm đã tiếp cận quy mô lớn thông qua các dịch vụ đại lý thương mại và hình thức “bán lại API”.

Các đại lý này sở hữu cụm tài khoản được gọi là “Hydra”, kiểm soát hàng chục nghìn tài khoản cùng lúc, trộn lưu lượng chưng cất vào các yêu cầu khách hàng bình thường; khi một tài khoản bị khóa, tài khoản mới sẽ ngay lập tức được thay thế. Đặc điểm của các cuộc tấn công chưng cất là số lượng lớn, lặp đi lặp lại và tập trung vào một số năng lực nhất định thay vì sử dụng đa dạng như người dùng thông thường.

Anthropic cho biết họ đang tiếp tục tăng cường đầu tư vào các biện pháp phòng thủ nhằm nâng cao độ khó và khả năng phát hiện các cuộc tấn công trích xuất dữ liệu kiểu này.

Anthropic cho biết hành động của DeepSeek nhằm tấn công năng lực suy luận trên nhiều nhiệm vụ và tạo ra các phương án thay thế không kiểm duyệt đối với các truy vấn chính sách nhạy cảm.

Công ty tiết lộ DeepSeek đã yêu cầu Claude tạo ra các phương án thay thế không kiểm duyệt cho các câu hỏi chính trị nhạy cảm – chẳng hạn liên quan đến nhân vật bất đồng chính kiến, lãnh đạo đảng phái hoặc chủ nghĩa độc đoán – với mục đích huấn luyện mô hình của mình để định hướng hội thoại tránh né các chủ đề kiểm duyệt.

Moonshot được cho là nhắm vào năng lực suy luận tác tử và sử dụng công cụ, cũng như mã hóa và phân tích dữ liệu. Trong khi đó, MiniMax tập trung vào năng lực mã hóa tác tử, sử dụng công cụ và điều phối. Anthropic cho biết họ đã phát hiện hoạt động tấn công của MiniMax trước khi mô hình mới của công ty này được công bố.

Anthropic nói rằng thời điểm họ ra mắt mô hình mới trùng với giai đoạn MiniMax tiến hành tấn công, và MiniMax đã nhanh chóng điều chỉnh chiến lược trong vòng 24 giờ, chuyển gần một nửa lưu lượng sang tấn công mô hình mới của Anthropic.

DeepSeek, Moonshot và MiniMax chưa phản hồi ngay yêu cầu bình luận.

Trong vòng gọi vốn gần nhất, Anthropic đã huy động được 30 tỷ USD, đưa mức định giá công ty lên 380 tỷ USD.

Công ty cho rằng các cuộc tấn công chưng cất từ phía doanh nghiệp AI Trung Quốc càng cho thấy sự cần thiết của việc Mỹ kiểm soát xuất khẩu chip cao cấp sang Trung Quốc, bởi bản thân hoạt động chưng cất cũng phụ thuộc vào chip tiên tiến và năng lực tính toán lớn.

Bài blog kết luận: “Hạn chế quyền tiếp cận chip vừa có thể làm giảm năng lực huấn luyện mô hình trực tiếp, vừa thu hẹp phạm vi khai thác không phù hợp”.

Google cho biết tin tặc dùng hơn 100.000 câu lệnh AI nhằm đánh cắp công nghệ của mô hình trí tuệ nhân tạo Gemini.

Từ khóa Dòng sự kiện DeepSeek Anthropic